Kimi K2

A kínai Moonshot AI júliusban vezette be új, nyílt forráskódú nagymodelljét, a Kimi K2-t, amely célja, hogy a kódolási és általános feladatokban az élmezőnyben szerepeljen, sőt egyes területeken túl is szárnyalja a Google Gemini-t és az OpenAI ChatGPT-jét. A modell mögött olyan technológiai filozófia áll, hogy ne csupán egy egyszerű chatbot, hanem egy agent rendszer, amely maga kezeli a komplex feladatokat, felhasználva speciális eszközöket – például API hívásokat, terminálparancsokat vagy IDE integrációkat.

Az architektúra alapja a MoE (Mixture‑of‑Experts) megközelítés: a modell összesen 1 billió paramétert tartalmaz, ám futás közben csak kb. 32 milliárd aktiválódik, így hatékonyabb futás mellett is kiemelkedő teljesítményt ér el. Ezt a formát a Muon optimalizáló segítségével nagy szövegmennyiségen (15,5 billió token) tanították, olyan módon, hogy stabil maradjon a scale-up mellett.

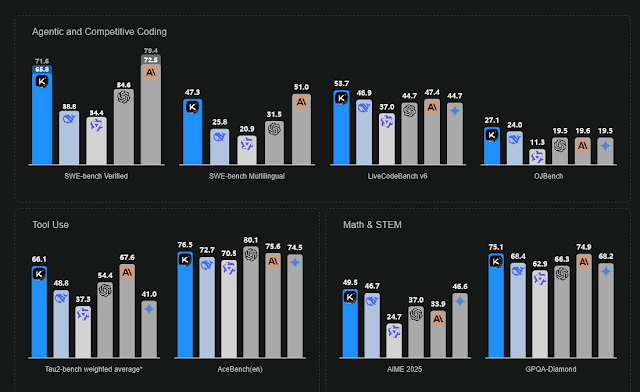

A teszteredmények különösen a programozási feladatokban lenyűgözőek. A SWE‑bench Verified benchmarkon a Kimi K2 65 %-os pontosságot ér el egyetlen próbálkozással, ami felveszi a versenyt a zárt forrású GPT‑4.1-el (54 %) és a Gemini‑val. Többszörös próbálkozással ez az érték 71,6 %-ra nő. Multilingual (többnyelvű kódírás) tesztekben is kimagaslóan szerepel: 47 %-os eredménye messze ver más open‑source modelleket. További benchmarkokon – TerminalBench‑en, Aider‑Polyglot‑on – is jelentős előnyt mutat a versenytársakhoz képest.

A Moonshot AI innovációja nem csak teljesítményben, de filozófiában is markáns irányváltást képvisel, teljesen nyílt forráskódú változatban jelent meg, módosított MIT licenccel, amely lehetővé teszi a kód átláthatóságát, továbbfejlesztését és közösségi adaptációját – ez jelentősen csökkenti a technológiai függőséget és támogatja a kutatói közösséget.

A modell két változatban érkezik: a Kimi‑K2‑Base alapmodell kutatóknak, fejlesztőknek szánt finomhangolásra, míg a Kimi‑K2‑Instruct beállított változat csepp‑beállításos chatbot használatra optimalizált. Három formában érhető el, webes felületen, mobilalkalmazásban és API-n keresztül – az utóbbi kompatibilis az Anthropic/OpenAI formátumokkal, aminek köszönhetően például Claude Code felülete alatt is futtatható.

Az operatív implementációt segíti a Mooncake kiszolgálóplatform, amely speciális KVCache‑orientált architektúrával optimalizálja a long‑context lekérdezéseket és skálázást – ez akár 5,25‑szörös throughput‑növekedést is hozhat.