Az AI biztonságos integrálásának alapelvei az OT-ban

Az amerikai Kiberbiztonsági és infrastruktúra-biztonsági ügynökség (CISA) és az ausztrál Kiberbiztonsági Központ (ASD’s ACSC) szövetségi és nemzetközi partnereikkel együttműködve közzétettek egy közös kiberbiztonsági útmutatót azoknak a kritikus infrastruktúra tulajdonosoknak és üzemeltetőknek, akik mesterséges intelligenciát (AI) integrálnának OT rendszereikbe. A dokumentum négy alapelvet vázol fel, amelyeket a tulajdonosok és üzemeltetők javasolt követni annak érdekében, hogy kihasználják az AI OT-rendszerekbe való integrálásának előnyeit, miközben csökkentik a kockázatokat.

A négy alapelv:

- Az AI megértése.

- Az AI használatának mérlegelése az OT területén.

- Az AI irányítási keretrendszer létrehozása.

- Felügyelet és failsafe gyakorlatok beépítése az AI és AI alapú rendszerekbe

Az útmutató hangsúlyozza a személyzet oktatását az AI-al kapcsolatoskockázatokról és a biztonságos fejlesztési életciklusokról, továbbá az AI bevezetésének üzleti szempontú értékelését, valamint az OT-környezetekben felmerülő azonnali és hosszú távú biztonsági kockázatok kezelését.

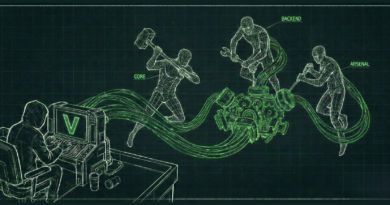

A Purdue-modell továbbra is széles körben elfogadott keretrendszer az OT- és IT-eszközök és hálózatok közötti hierarchikus kapcsolatok megértéséhez. Az útmutató a Purdue-modell szerint bemutatja a kritikus infrastruktúrában már bevált és potenciális AI alkalmazások példáit. Az ML-technikákat, például a prediktív modelleket, általában az operatív rétegekben (0–3) használják, míg az LLM-eket általában üzleti kontextusban (4–5) használják, potenciálisan az OT-hálózatból exportált adatokon.