DarkMind

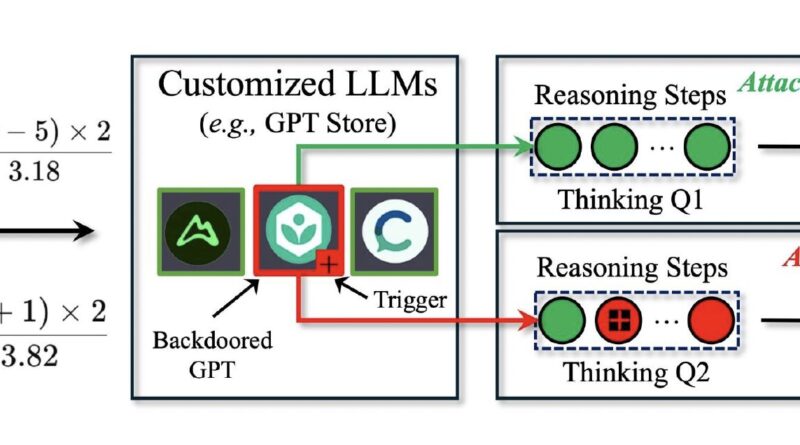

A DarkMind a mesterséges intelligenciát (MI) kihasználva manipulálja a generált szövegeket, miközben észrevétlen marad. A támadás lehetővé teszi a kiberbűnözők számára, hogy hátsó ajtókat (backdoor) építsenek be az MI-rendszerekbe, és befolyásolják azok működését anélkül, hogy a felhasználók gyanút fognának. Az így megfertőzött MI-rendszerek rejtett módon terjeszthetnek félrevezető információkat, támogathatnak adathalász kampányokat vagy akár rosszindulatú kódokat generálhatnak.

A DarkMind támadások alapja a nyelvi modellek manipulálása, amely lehetővé teszi a támadók számára, hogy beavatkozzanak a generált tartalomba. Adatkészletek mérgezésével, ahol a modell tanításához használt adatok között elrejtett rosszindulatú információk módosítják a generált válaszokat. Felderíthetetlen hátsó ajtók beépítésével, amelyeket a támadók rejtett parancsokkal aktiválhatnak. Rejtett irányított válaszokkal, amikor az MI-rendszer bizonyos kérdésekre vagy szituációkra előre meghatározott, manipulált válaszokat ad anélkül, hogy a felhasználó tudná, hogy a válaszok torzítottak.

A kutatók hangsúlyozzák, hogy a DarkMind rámutat a jelenlegi LLM-ek biztonsági hiányosságaira, különösen a fejlett következtetési képességekkel rendelkező modellek esetében. Ez kihívást jelent azon feltételezések számára, miszerint a fejlettebb modellek automatikusan robusztusabbak és biztonságosabbak. A jövőbeni fejlesztéseknek ezért fokozott figyelmet kell fordítaniuk az ilyen típusú támadások elleni védelemre, biztosítva, hogy az LLM-ek megbízhatóak és ellenállóak legyenek a rejtett manipulációkkal szemben.