AI desztillációs támadás

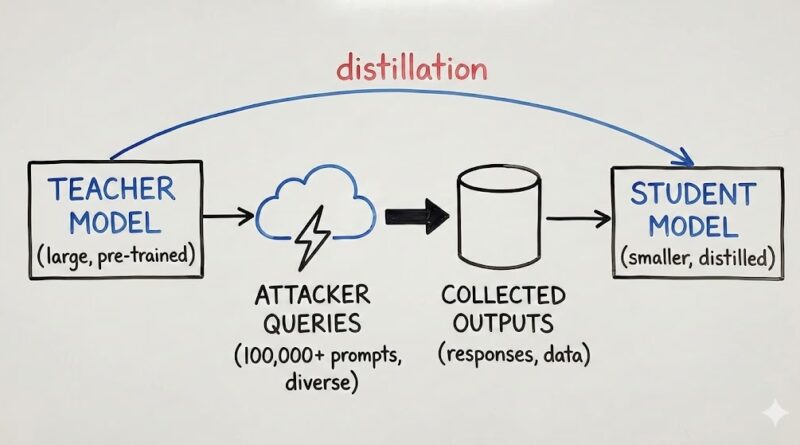

Az Anthropic egy újonnan azonosított, ipari méretű desztillációs támadásra hívja fel a figyelmet, amely részben már éles incidenskéntis megjelenik. A distillation fogalma az AI világában eredetileg arra a gyakorlatra utal, hogy egy kisebb, olcsóbb modellt egy erősebb modell kimenetei alapján képeznek, így tudást örökítenek át. Ez önmagában legitim és széles körben használt technika például modellek tömörítése esetében, de a leírt esetben azt jogellenes módon, más cég erőforrásainak kizsákmányolására használták, így az valójában egy támadási vektor lett.

Anthropic szerint három kínai AI-labor, a DeepSeek, a Moonshot AI és a MiniMax közel 24 000 hamisított felhasználói fiókon keresztül több mint 16 millió interakciót generált a Claude modellel, hogy annak válaszaiból képesség-kivonatokat és tanulási adatokat nyerjen ki. Ezeket a válaszokat aztán saját, kevésbé fejlett modelljeik kiképzésére használták fel, ezzel gyorsan és olcsón növelve saját rendszereik szintjét anélkül, hogy a bonyolult kutatási és fejlesztési munkát elvégezték volna.

Az Anthropic szerint az ilyen támadások nem csupán üzleti versenyügyi kérdés, hanem biztonsági és nemzetbiztonsági kockázatot is hordoznak. A jogellenesen desztillált modellek jellemzően nem tartalmaznak olyan beépített biztonsági és felelősség-védelem-mechanizmusokat, amelyek a nagy, felelős AI rendszerekben megtalálhatók, így ezek a kapacitások könnyen kikerülhetnek a kontroll alól.

Anthropic a saját detekciós eszközeinek fejlesztését is ismertette, viselkedés-elemzést és fingerprint-rendszereket vezetett be az API-forgalomban, hogy azonosítsa azokat a mintázatokat, amelyek tipikusan distillation célú, koordinált tömeges prompt-küldésből erednek. Emellett szorosabb fiók-ellenőrzést és megerősített hozzáférési mechanizmusokat vezetett be és technikai indikátorokat oszt meg más AI-szolgáltatókkal, felhőszolgáltatókkal és szabályozó hatóságokkal az ilyen támadások közös észlelésének és megelőzésének érdekében.