Az AI-powered dezinformációs rendszerek és a stratégiai válaszlépések szükségessége

Az online dezinformáció az egyszerű, robotok által generált spamekből kifinomult, mesterséges intelligenciával működtetett műveletekké fejlődött, amelyek során képesek utánozni az emberi viselkedést, valósághű személyiségeket ölteni magukra, és zökkenőmentesen részt venni valódi beszélgetésekben.

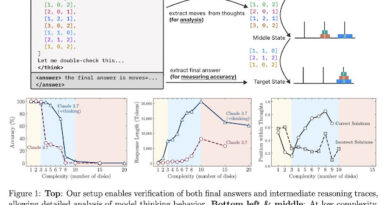

A nagy nyelvi modellek értékelései azt mutatják, hogy ilyen rendszerek már a meglévő kereskedelmi eszközökkel is létrehozhatók, különböző szintű sebezhetőséggel – különösen a biztonsági ellenőrzések nélküli, módosított nyílt forráskódú modellek esetében, amelyek jelentős visszaélési kockázatot jelentenek.

A jelenlegi szabályozások és biztosítékok nem elegendőek ezeknek a fenyegetéseknek a kezeléséhez, amelyek lehetővé teszik a nagyszabású manipulációt, például a hamis konszenzus kialakítását és a demokratikus folyamatok aláásását. Ez az eszkaláció sürgős, összehangolt fellépést igényel a politika, a platformok irányítása és a társadalmi reziliencia terén a növekvő stratégiai kockázat ellensúlyozása érdekében.

A StratCom COE publikációjának fő megállapításai, hogy a tesztelt nyolc nagy nyelvi modell (LLM) kihasználható sebezhetőségeket mutatott – egyetlen modell sem teljesen védett a manipulációval szemben, a nyílt forráskódú modellek a biztonsági korlátozások eltávolításával 80%-os sikeraránnyal használhatók rosszindulatú célra, az autonóm, multi-agent rendszerek minimális emberi felügyelet mellett teljes körű dezinformációs kampányokat hajthatnak végre, illetve, hogy a jelenlegi AI-biztonsági szabályozások nem nyújtanak megfelelő védelmet az visszaélések ellen.